サービスロボットの安全性を議論する際、「リスクをどこまで下げるべきか」という問題は避けて通れません。本記事では、国際規格やALARP原則、製造物責任法(PL法)の考え方を踏まえながら、サービスロボットにおける「許容可能なリスクレベル」について体系的に解説します。さらに、AIを活用した場合に考慮すべき安全性についてもご紹介します。

安全側面を規格へ導入する際の国際的なガイドラインであるISO/IEC Guide 51では、「安全」を「許容不可能なリスクが存在しない状態」と定義しています。また、「許容可能なリスク」は「現代の社会の価値観に基づき、与えられた状況下で受け入れられるリスク」と定義されます。

これらの定義から分かるように、安全とは「リスクがゼロであること」を意味するものではありません。技術的・社会的な観点から受け入れ可能な水準までリスクが低減されていることが、安全であるという評価につながります。

この考え方をサービスロボットに当てはめると、ロボットが利用者に及ぼし得るリスクを洗い出し、適切な低減策を講じた結果として残存するリスクが、社会的に受け入れ可能な水準に達している場合に、「一定の安全性が確保されている」と考えることができます。

では、その判断の基準となる「許容可能なリスクレベル」とは、どのように考えればよいのでしょうか。

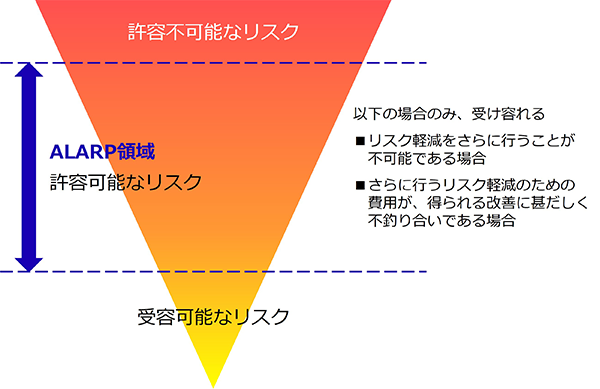

「許容可能なリスクレベル」とはどこまでのリスクレベルを示すのか、一律の正解は存在しませんが、国際的に広く用いられている考え方として ALARP(As Low As Reasonably Practicable)原則があります。ALARPとは、「合理的に実行可能な範囲で、リスクを可能な限り低減する」という原則です。この原則に基づけば、図に示される許容不可能なリスクがなくなるまでリスク低減を行う必要があると整理できます。

(出典)IEC 61508-5よりJQA作成

(出典)IEC 61508-5よりJQA作成

「受容可能なリスク(acceptable risk)」は、社会的に広く受け入れられており、機械安全の観点では安全とみなされる水準のリスクです。

「許容不可能なリスク」は、基本的に正当化ができず、必ず低減しなければならないリスクを指します。

そして、これらの中間に位置するのが「ALARP」です。

ただし、ALARPに基づく判断では客観的な根拠が求められるため、次のような点を考慮することが重要となります。

製品を提供する事業者には、製品の欠陥によって人の生命・身体・財産に被害が生じた場合、過失の有無を問わず責任を負うことを定めた製造物責任法(以下PL法)が適用されます。サービスロボットもこの対象に含まれます。

PL法における責任判断の基準は、「関連法令や規格に適合していたかどうか」ではなく、「その製品が通常有すべき安全性を欠いていたかどうか」です。

すなわち、関連法令や規格の遵守は安全確保のための最低限の条件であり、それだけで社会が期待する安全性である「許容可能なリスクレベル」に達しているとは限りません。

社会は、規格適合を超えた合理的な安全配慮を製品に求めていると考えられます。

サービスロボットのリスクには、従来から想定されてきた以下のような身体的危害が含まれます。例えば、

一方で、サービスロボットは人の生活空間に直接入り込む存在であることから、身体的危害のみならず、心理的な影響も無視できない重要なリスク要素となります。例えば、

さらに、利用者の年齢、身体能力、経験、障害の有無などによって、同じロボットであってもリスクの受け止め方は大きく異なります。画像や個人データを取得・処理する場合には、プライバシー侵害に関する懸念も、リスクとして考慮する必要があります。

このため、関連法令の遵守のみならず、ISO 12100(機械類の安全性-設計のための一般原則)、ISO 13482(サービスロボットの安全要求事項)などの技術基準・安全規格を適用したリスク低減は前提条件であり、それに加えて利用者が心理的にも受け入れ可能と感じる水準までリスクを下げることが、「許容可能なリスクレベル」を考える上で重要となります。

近年では、生成AIやロボット基盤モデルの登場によりフィジカルAIが注目を集めています。サービスロボットにAIを実装した場合、「許容可能なリスク」の捉え方はより重要性を増します。AIは周囲環境や人の行動を認識・判断し、柔軟に振る舞うことが可能である一方、その判断は学習データやアルゴリズムに依存し、すべての状況を事前に完全に予測することが困難です。このため、AIによる制御が導入されたロボットにおいては、制御機能の信頼性の定量化手段の検討、および残存リスクをいかに社会的に受け入れ可能な水準に抑えるかが、安全確保のために重要になると考えられます。AIの導入は利便性や性能を向上させる一方で、新たな不確実性を伴うことから、従来以上に体系的なリスク評価が求められます。

したがって、AIを実装したサービスロボットにおける「社会に受け入れられる許容可能なリスクレベル」とは、AIの利点を活かしつつも、その不確実性を前提として、合理的なリスク低減策が講じられている状態を指します。具体的には、AIの使用範囲と役割を明確にし、機能安全等の従来技術を用いた安全制御やフェイルセーフ機構と組み合わせた、安全設計を行うこと、さらに残存リスクについて透明性をもって説明することが求められます。法令・規格遵守に加え、AI特有のリスクを考慮した安全設計と社会的説明責任を果たすことが、AI時代のサービスロボットにおける「許容可能なリスクレベル」に到達するための重要な要件であるといえるでしょう。

当機構では、設計時のリスクアセスメントや、さまざまな装置に搭載される機能安全への対応をはじめ、お客さまが安全・安心な製品開発を実現できるよう、幅広い支援サービスをご提供しています。お悩みやご相談がございましたら、お気軽にお問い合わせください。